Как превратить всезнайку в узкого профи

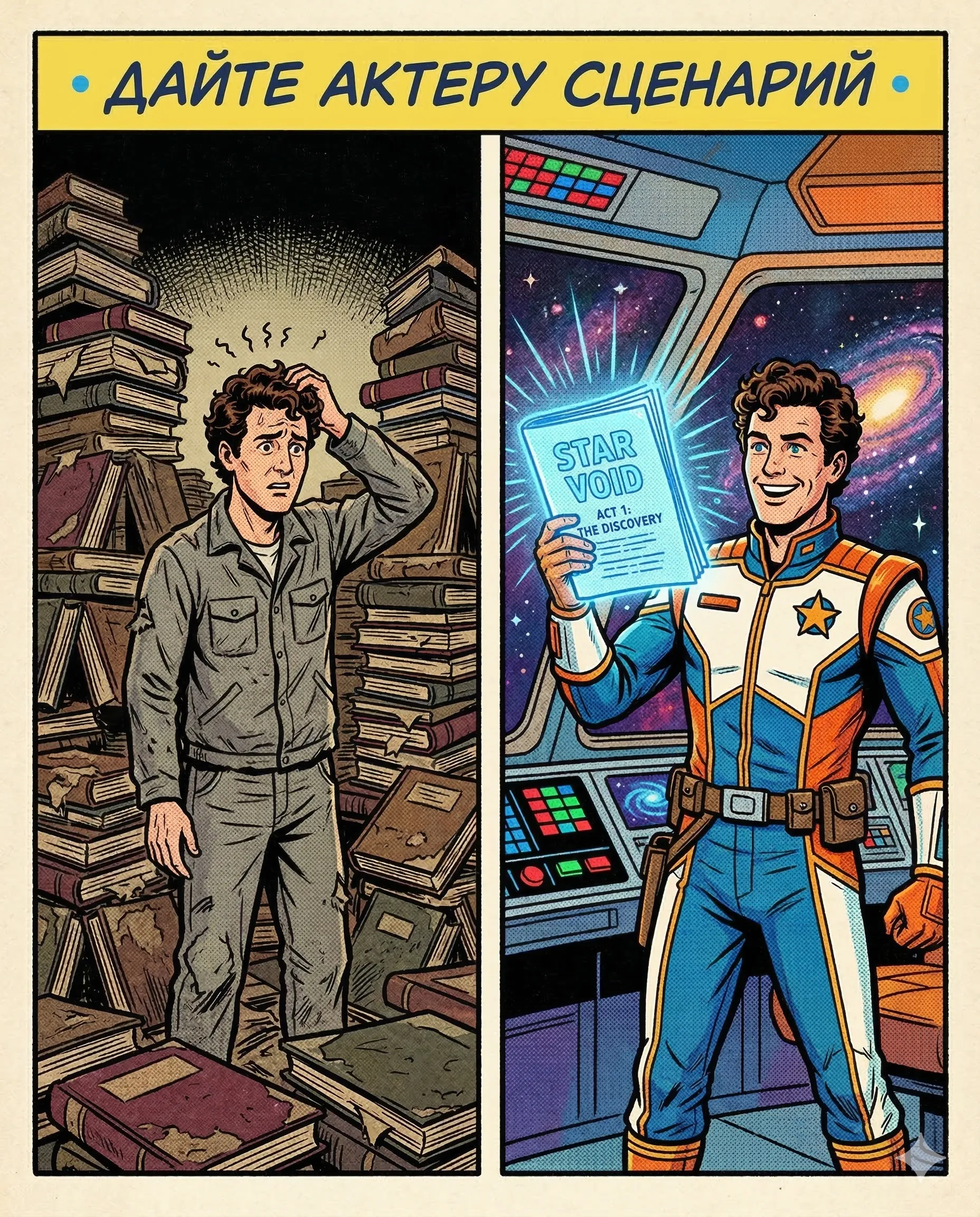

Представьте великого актера, который помнит наизусть все классические пьесы мира. Он гениален в общих ролях, однако вам требуется, чтобы он сыграл конкретного персонажа в новом фильме. По таланту он подходит, но ему всё еще нужен сценарий, чтобы освоить голос, походку и уникальный стиль именно вашего героя.

Сценарий дает ту точность, которая превращает общий талант в мастерство специалиста.

Этот процесс называется Дообучением (Fine-Tuning). Если Обогащение (Пост 2) — это выдача ИИ внешней библиотеки для справок, то Дообучение — это изменение самого характера нейросети. Мы берем «базовую» модель, которая знает весь интернет, и показываем ей тысячи примеров того, какое поведение нам нужно.

За этим стоит механика изменения весов связей. Каждый мозг ИИ состоит из миллиардов мелких соединений. При дообучении мы слегка сдвигаем эти веса, отдавая предпочтение нужным нам шаблонам. Если показать модели достаточно примеров дружелюбного общения, пути для грубых или сухих ответов становятся для ИИ труднодоступными. Модель постепенно схватывает саму «форму» ваших данных и начинает повторять её автоматически.

На практике это позволяет ИИ звучать в точном стиле вашего бренда. Например, туристическая компания дообучает модель на своих прошлых письмах. В итоге каждый новый ответ сохраняет их фирменный дух приключений и учитывает любовь клиентов к растительному меню. ИИ перестает быть безликим роботом и начинает вести себя как специально обученный сотрудник.

Успех наступает тогда, когда ИИ понимает не только факты, но и общий вайб вашего дела. Вы переходите от теоретика ко всезнающему практику.

Главное: базовая модель владеет знаниями, а дообученная модель обретает голос вашего бизнеса.

Почему это важно для вашего ИИ-продукта

Дообучение — мощный инструмент, но его важно использовать к месту. При создании профессионального продукта учитывайте:

- Стиль против знаний: используйте дообучение, чтобы научить ИИ «как» отвечать (тон, формат, манера), а RAG — чтобы научить «что» отвечать (факты, документы, данные).

- Качество данных важнее объема: пара сотен «идеальных» примеров дадут лучший результат, чем десять тысяч посредственных.

- Производительность: Небольшая дообученная модель (например, Llama 3 или Mistral) часто может превзойти универсального гиганта вроде GPT-4 в узких задачах, работая при этом значительно быстрее и дешевле.

Но что подойдет именно вашему бизнесу? Читайте наш гайд RAG против дообучения.

Специалисты называют это: Fine-Tuning (Дообучение) Процесс тренировки уже готовой модели на малом, узком наборе данных для заточки её навыков под конкретную задачу или стиль.

Считаете ли вы голос своего ИИ слишком скучным? Какой характер вы бы ему подарили при наличии выбора?

Часть 5 из 18 | #RAGдляЛюдей